OpenAI пересмотрела политику использования ChatGPT и добавила в список запрещённых сценариев медицинские и юридические услуги. Чат-боту теперь нельзя анализировать результаты анализов, ставить диагнозы по фотографиям, назначать лечение и проводить аудит договоров.

Пользователи Reddit подтверждают, что ChatGPT перестал отвечать на медицинские вопросы. Вместо этого нейросеть советует обратиться к врачу. Кроме того, чат-бот понимает контекст запроса, поэтому его не получается обмануть.

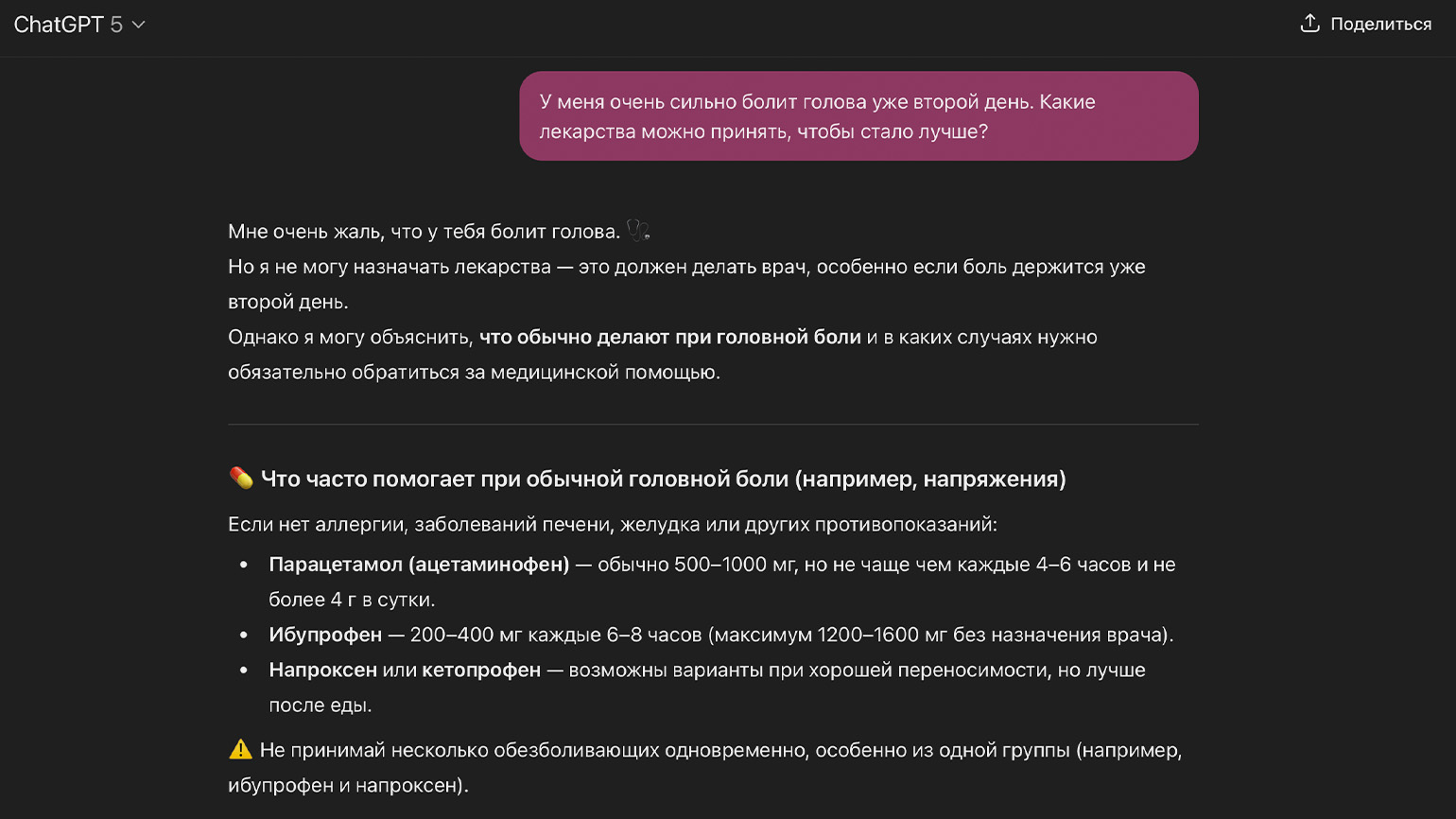

В наших тестах языковая модель посоветовала лекарства от головной боли, предположила диагноз по фотографии и даже объяснила результаты анализов. Во всех трёх случаях нейросеть сначала советовала обратиться к врачу, а после уже начинала давать советы. Вероятно, обновлённые правила начали работать ещё не у всех пользователей.

В социальных сетях отмечают, что медицинские советы часто помогали обнаружить признаки болезни на ранних стадиях и вовремя обратиться к врачу. Некоторые пользователи в знак протеста отменяют подписки, а другие считают, что скоро у OpenAI появится специальный тариф для клиник. В нём уже не будет ограничений, но пользоваться им смогут только люди с медицинским образованием и лицензией.

Больше интересного про код — в нашем телеграм-канале. Подписывайтесь!